Robust 3D Self-portraits in Seconds

http://www.liuyebin.com/portrait/portrait.html

人物の3DモデルをRGB-Dのシーケンスから生成する手法の提案.著者らの先行研究であるDoubleFusionでは,SMPLモデルを利用したトラッキングを行っていたが,SMPLモデルは衣服を身に着けていない人物のモデルであるため,ワンピースのような足の形状が隠れてしまう衣服などを来ていた場合にトラッキング精度が低下してしまう.そこで,単眼画像からの人物モデル生成手法であるPIFuと組み合わせることで,トラッキング精度の低下を防いでいる.

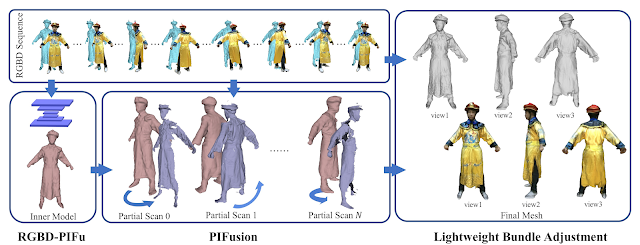

提案手法では,RGB-Dカメラの前で人が自分で360度回転することで全身の撮影を行い,この撮影されたRGB-D動画像を入力として人物の3Dモデルを生成する.PIFuと異なり,RGB-Dの入力が得られるため,PIFuにおける空間のサンプリングは取得されたDepthの周辺に限定することができるため,より精度良く高速にモデルを生成することが可能となっている(RGBD-PIFu).RGBD-PIFuによって得られたモデルはトラッキングに用いられ,各フレームで取得されたDepth mapを使ってモデルをアップデートすることで詳細な形状を復元していく.トラッキングにはDoubleFusionと同様のアルゴリズムが利用されている.また,一度に全集を復元するのではなく,全周をいくつかのパーツ(portion)に分解して復元を行う.最終的に各パーツをBundle Adjustment (BA)によって統合する.ただし,全てのフレームを使ったBAは処理コストが高いため,各パーツ毎にキーフレームを選択し,このキーフレームを使って統合を行う.これにより,計算時間を大幅に抑えることが出来る.

コメント

コメントを投稿